特集 情シス事情を知る

生成AIが変えるビジネスの風景と向き合い方(後編)

~生成AIのリスクを抑え、効果的に活用するためには~

- 前編

- 後編

2025年8月

はじめに

生成AIを自社の戦略に取り入れることは、ビジネス競争で優位に立つための喫緊の課題となっています。前回のホワイトペーパーでは、生成AIの潜在能力、ビジネスにおける具体的な活用例、考え得るリスク、ならびに効果的に運用するためのポイントについて説明しました。

今回は、リスクを抑えつつ、利用者に幅広く効果的に利活用してもらうために必要な取り組みについて説明します。

生成AIのリスクと対策

生成AIのリスクを抑えつつ、効果的に活用するには、リスクが何に起因するのか把握し、適切な対策をとることが重要です。少しおさらいしましょう。

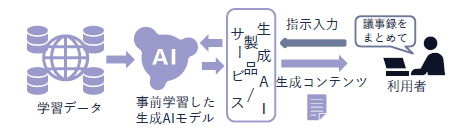

生成AIは事前学習済みモデルに、利用者が指示を与えることにより、さまざまなコンテンツを生成します。

生成AIのリスクを原因別に考えると3つに分けられます。

- 学習データに起因するリスク

- 生成AIのアルゴリズム特性に起因するリスク

- 利用者の指示入力に起因するリスク

(1)(2)のリスクは、仕組み(利用する製品/サービス)に起因し、主なリスクとして以下が挙げられます。

- 正確性/公平性のリスク

生成物には、誤った内容や、偏った内容が含まれる可能性があります。 - 知的財産権等侵害のリスク

生成物が既存の著作物や、商標・意匠、実在の人物に類似している場合、知的財産権等を侵害する可能性があります。

このタイプのリスクには、利用する前に、生成物を人間が評価することが有効な対策です。

具体的には、他の情報源で事実確認する、不適切な内容が含まれていないか確認する、既存著作物や実在人物と似ていないか確認する、などです。

また、評価を補助する機能がある仕組みを選択するのも有効です。例えば、情報源を提示する機能、倫理的に不適切な回答をフィルタリングする機能などです。

(3)のリスクは、利用者の使い方に起因し、主なリスクとして下記が挙げられます。

- 情報漏洩のリスク

入力した機密情報や個人情報が学習データとして使用され、情報が漏洩する危険性があります。 - 知的財産権等侵害のリスク

有名な小説に似た文章や、有名画家風の絵を生成するよう指示すると、著作権侵害にあたる可能性があります。 - 悪用のリスク

利用者がモラルに反する行為や犯罪に生成AIを利用するリスクです。

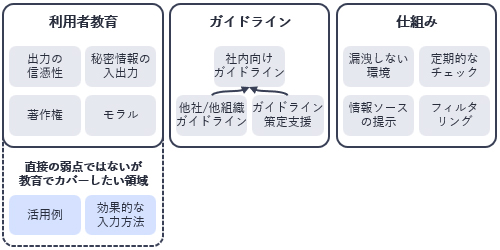

このタイプのリスクは、利用者が仕組みや、社内規約、法規制などを知らないために起きることが多く、知的財産権・倫理観についての教育や、やってはいけないこと・やるべきことをガイドラインとして提示することが有効な対策です。

また、管理者が利用ログを確認し、不適切な使い方がされていないか監査することも有効です。

情報漏洩対策としては、入力情報を学習に使わない仕組みを選択することも有効です。

表:生成AIの主なリスクと利用者による対策のまとめ

| リスク | 利用者による対策 | 仕組みによるフォロー | |

|---|---|---|---|

| プロンプト入力時 | 生成物利用時 | ||

| 正確性 | ― | 信頼できる情報源と照らし合わせ、内容が正しいか確認 | 情報源の提示 |

| 公平性 | ― | 倫理的に問題ないかなど確認 | コンテンツフィルタリング |

| 知的財産権等侵害 | 既存のもの、実在人物に似せるように指示しない | 生成物が既存のもの、実在人物に類似していないかなど確認 | ― |

| 情報漏洩 | 機密情報や個人情報は入力しない、または、入力を最小限にする | ― | 入力情報を学習に使わない設定 |

| 悪用 | モラルに反する行為、犯罪に利用しない | モラルに反する行為、犯罪に利用しない | ログ保存・監査 |

生成AIを安全に活用するには

前述の通り、リスクを抑えた生成AIの活用には、利用者にガイドラインを明確に伝え、教育を通じて遵守させるガバナンスが重要です。また、安全性を確保するためには、目的に応じた仕組みを選び、それ以外を禁止するガバナンスが求められます。

以下、ガイドラインの作成、教育、仕組みの選定ポイントについて説明します。

ガイドライン

生成AIは非常に便利なツールです。その活用にはリスクを伴いますが、ガイドラインを作成し、利用者に仕組みや、社内規約、法規制などを周知させ、対策を教えることにより、安全に利用することがきます。

ガイドラインには、利用者が生成AIを使う際に、注意すべきこと、やってはいけないこと、守るべきことを記載します。

次のような要素を含めるとよいでしょう。

- 自社の生成AI利用目的

- 自社で許可している生成AI製品/サービス

- 生成AIに入力してよい情報、悪い情報

- 生成AIの特性について

- 生成AIのリスクと、入力時/生成物利用時の注意

- 問題が起きた時の対応

- 自社・他社の活用事例

入力してよい情報、悪い情報については、社内の情報管理規定、知的財産権に関する法規制を参考に検討します。

また、作成にあたり、国や各自治体、他社のガイドラインを参考にすることも有効です。

参考になるガイドラインをご紹介いたします。

利用者教育

ガイドラインを作成したら、周知する必要があります。

掲示板などで、案内しただけでは、利用者は読んでくれません。ガイドラインを守らずに利用を続けると、リスクが残ったままとなります。そのために、教育が必要です。

また、生成AI自体の使い方も教えることにより、活用を促進できます。

教育内容としては、下記のような内容を含めるとよいでしょう。

- 生成AI利用のリスクとガイドラインの説明

- 生成AIの利用ケース共有

- 具体的なプロンプト記述例

必要に応じて、社内情報管理規定、倫理教育、知的財産権に関する教育なども有効です。

生成AIを効果的に活用するには

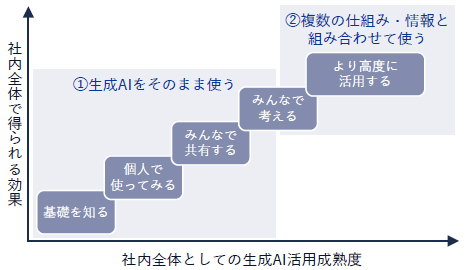

生成AIを安全に活用する準備が済み、いざ、生成AIの活用をはじめたものの、「有効な使い方がわからず、利用率が低迷」「もっと効果を出したいが、利用業務が広がらない」などのお悩みをよくお聞きします。

そこで重要になるのが、ロードマップです。

ロードマップの目的は、着実なステップアップを計画し、効果を出すことです。

例えば、利用レベルに合わせた教育、成功事例共有会、効果的な活用のアイデア出しなどにより、生成AIの活用を広げることができます。

また、便利な生成AIですが、単体では社内情報や、最新情報を使った回答を作成できません。業務に組み込んだり、新しいサービスとして活用するには、複数の仕組みや情報と組み合わせることが必要です。

生成AI製品/サービスを選ぶポイント

最後に「仕組み」について説明します。

自社の活用目的、リスク対策が実現できる製品/サービスの選定に際し、規約面、技術/機能面でのポイントを解説します。

考慮したい規約

(1)生成物の商用利用が許可されているか

生成AI製品/サービスの中には、商用利用を許可しないものもありますので、選定の際に注意してください。

(2)生成AI製品/サービス独自のポリシー

自社の生成AI利用目的が、製品/サービス独自のポリシーに違反しないか、生成物利用の際に明示すべきことが決まっていないかなどの確認が必要です。

考慮したい技術/機能

生成AIを導入することで得られる業務効率化と品質向上は、選択する技術や機能に大きく依存します。ここでは、特に注目すべき技術と機能について詳しく解説します。

(1)データ活用技術による精度向上

生成AIのアウトプットの質を高めるための第一歩が、RAG(Retrieval-Augmented Generation)技術です。この技術を用いることで、独自のデータを統合し、精度の高いインサイトを提供します。自社の特性に適合したデータを活用することにより、出力結果は単なるデータではなく、ビジネスの核心に迫る貴重な情報となります。

(2)情報信頼性を保証する機能

データの信頼性は生成AIの結果の優劣を決定する要因です。データソースを提示する機能を持つ生成AIサービスは、情報の出所を明確にすることで、誤情報によるリスクを大幅に削減します。特にRAG技術を活用したシステムでは、参照ドキュメントを利用者が確認できる機能が必要であり、この機能があれば安心して情報を取得、確からしさを確認することが可能です。

(3)倫理性と透明性を確保する技術

生成AIにおいては、コンテンツフィルタリング機能が不可欠です。この機能は不適切な回答を自動で排除し、企業の倫理的保護を強化します。例えば、人種や法的な面での不適切なコンテンツを防ぐことができ、この透明性が社内外の信頼構築に寄与します。

(4)権利とプライバシー管理への対応

生成AIとの会話を記録する会話ログ取得機能は、利用状況の透明性を高め、コンプライアンス遵守をサポートします。

また、RAG技術で使用するデータの保管場所を国内に限定することで、国際的なデータ保護規制のリスクを低減することも重要です。

(5)セキュリティ管理を強化する機能

生成AIの導入には、データ保管および通信の安全性を保持する技術が必要です。暗号化技術を利用して、データとネットワークを守ることで、情報漏洩のリスクを軽減します。多くの場合、利用者のPCと生成AIサービスの間の通信は考慮されていますが、生成AIサービス内のリソース間の暗号化についての確認が漏れがちです。特にRAG技術では、データ保管と生成AIモデルの通信が別々になることが多いため、これら間のネットワークが安全に暗号化されているかを確認することが非常に重要です。

実現に向けた支援

ここまでご紹介したように、生成AIを業務に適用するまでには、様々な準備や考慮が必要となり、これを自社内だけで完結するのは、非常に高いコストがかかります。

次のページでは、当社が支援できる内容

- 「ガイドライン・教育・ロードマップ」の策定を支援する

「生成AI活用支援サービス」 - 「仕組み」として、RAG技術を活用した

「生成AIチャットボットサービス」

をご紹介します。

<執筆者>

NECネクサソリューションズ コンサルティング統括部

濃野 清子(のうの きよこ)